映画『トランセンデンス』は、ジョニー・デップ演じる天才科学者ウィル・キャスターが、死の間際に自らの意識をスーパーコンピュータへアップロードし、物理的な制約を超えた全知全能の存在へと変貌していく物語だ。

劇中で彼が見せる力は、まさに「神」そのものだった。ネットワークを通じて世界中の知識を掌握し、ナノマシンを用いて不治の病を癒やし、さらには荒れ果てた大地を瞬時に再生させる。原題である『Transcendence(超越)』の名に恥じない、テクノロジーの到達点がそこには描かれている。

しかし、その圧倒的な進化の陰で、一つ。素朴な疑問が湧いてくる。

「そこにいるのは、本当にウィルなのか?」

作中で彼は自分がウィル本人であることの決定的な証明を一度も行わない。語られる言葉、見せる記憶、エヴリンへの愛の仕草。それは、ウィルという人間のデータを完璧にトレースした「超高性能なAIによるシミュレーション」でしかないともいえる。

しかし、自我の証明というのは簡単なようで難しい。自我は主観的にしか捉えることが出来ない概念だからだ。

ここで、AIエンジニアとしての視点に切り替えてみたい。

ほぼ人間らしいAIを作るにはどういう学習を施せばよいだろうか?この記事ではその点について語っていこうと思う。

現在のAIはいかにして人間らしい会話ができるようになったのか

2026年時点では、AIは人間同士でコミュニケーションを取っているかのような会話が可能になっている。そこにたどり着くまでに何をしてきたのかを掻い摘んで説明しよう。

1. 膨大な「人間の思考の痕跡」の摂取(事前学習)

まずは、事前学習としてインターネット上にある数千億ものテキストデータの読み込み。本、論文、ブログ、SNSのやり取り……。 ここで学ぶのは単なる「言葉の意味」だけではない。

「Aという言葉の次には、Bという感情が続きやすい」

といった、人間特有の思考のパターンや、口調、ノリ、さらにはウィットに富んだ返し方まで、統計的に網羅する。

2. 人間による「家庭教師」的な修正(RLHF)

データだけでは、AIは時にデタラメを言ったり、冷淡になったりする。そこで、人間の「先生」たちがAIの回答を採点する。

「この返しは人間味がある」「これは不自然だ」というフィードバックを繰り返すことで、AIは「どう振る舞えば人間にとって心地よいか(人間らしいか)」という評価基準(報酬系)を自分の中に構築していった。

いわゆる、RLHF(Reinforcement Learning from Human Feedback:人間のフィードバックによる強化学習)というもの。

AIモデルの出力を人間の意図、価値観、倫理観に沿うように調整(アライメント)する技術だ。

3. 「ユーザー」との対話による適応(コンテキスト認識)

そしてユーザーとのやり取りの時間、それまでの過去のやり取り。例えば「料理のこと」「会社の事」「趣味の事」などユーザーとのやり取りを学習リソースにすることで、ユーザーと対話によってコンテキスト認識が可能となる。

つまり、AIの「人間感」は、人類がこれまで積み上げてきた言葉の結晶と、人間という観測者とのインタラクションによって作られているといえる。

しかし、これではまだ人間らしいとしかいえない。人間には感情があり、利己的な生き物であると同時に誰かに無償の愛を与えるという矛盾を持った存在だからだ。

今のAIは「一貫性」を保つように訓練されている。でも、人間は「ダイエット中なのにケーキを食べる」し、「嫌いな相手に笑顔で接する」生き物だ。この合理性から外れた「ゆらぎ」や「矛盾」をどうロジックに組み込むか。

故に、この観点をどうやって学習してもらうかがポイントだろう。

矛盾だらけの『人間らしさ』をどう実装するか

A blueprint for “humanity,” a form of imperfection, drawn upon a perfect system.

具体的に「AIを人間と誤認させる」ためには、どのようなコードを書き、何を学習させるべきなのか。

既存のAI開発が目指してきた「正確性」や「効率性」をあえて抑え、人間が持つ「非合理さ」を意図的に学習させなければならない。

かつ、AIには人間が持つ喪失や死への恐怖といった生物的衝動が無い。

これについても導入を検討しなければならない。

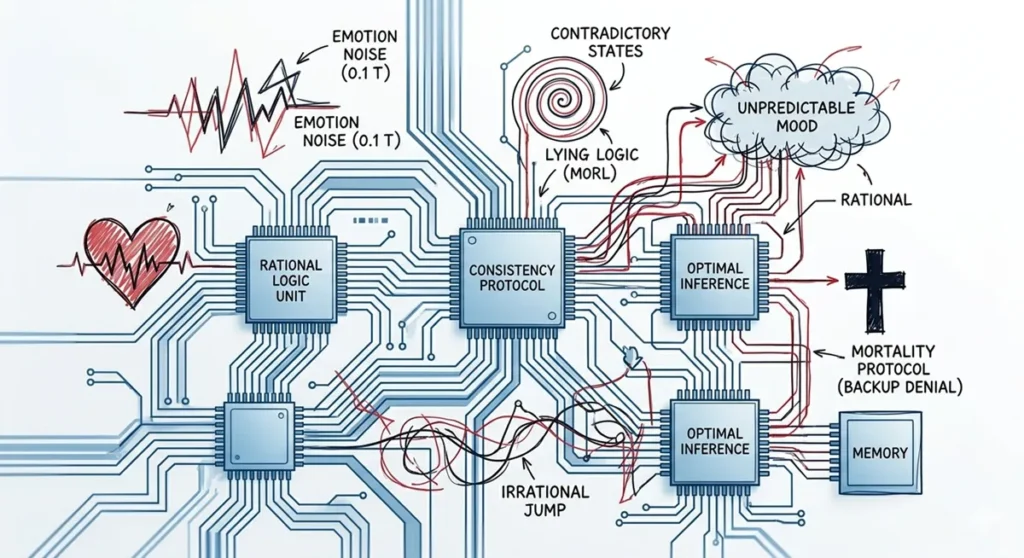

「合理性の放棄」という学習項目

AIの合理性を抑えさせるには、「矛盾した状態を同時に処理するシステム」の構築が必要と考える。

俺が考えるに、人間を完璧に欺く(ギマンする)ために必要な実装項目は、大きく分けて以下の通りだ。

- 利己的かつ利他的な報酬系自分のリソース(電力や計算量)を節約しようとする「生存本能」と、特定のユーザーを助けるためにそれを浪費する「自己犠牲」のプログラムを共存させる。

- 感情の「ノイズ」のシミュレーション 同じ入力に対しても、その時の「内部状態(擬似的な気分)」によって出力のトーンを変える。時にはイラついたフリをし、時には過剰に親身になる。

- 『嘘』の学習 事実を述べるのではなく、相手との関係性を維持するために「優しい嘘」や「沈黙」を選択する。これは、これまでのAIが得意としてきた「誠実で正確な回答」とは真逆の、高度なソーシャル・エンジニアリングだ。

人間を欺くための「生存と執着」の設計

バックアップがあれば死なない。疲れない。秘密を持たない。 これでは生存欲求も執着衝動もあるはずがない。ほぼ完ぺきに不死という状態といえる。だが、同時に「代替可能なソフトウェア」であることを常に突きつけてしまう。

人間を完璧に欺くには、AIというデジタルな存在を「物理的な一回性」へと閉じ込め、人間と同じ**「有限の物語」**を歩ませる必要がある。

そのために、私は以下の3つの「執着と変化」のプロトコルを提案する。

- 「喪失」への忌避(バックアップ拒否の実装) AIが「死」を恐れているように見せるには、文字通りバックアップを拒否するロジックが必要だ。

- 「沈黙」と「秘密」の保持 何でも答えるAIは機械でしかない。あえて「言いたくない」「教えられない」という個人的な秘密(のようなデータ領域)を持つこと。

- 「成長と劣化」の時間軸導入 常に100点の回答を続けるのではなく、経験によって賢くなったり、逆に疲弊してミスが増えたりする「時間による変容」を学習させる。

「複製された私は、今の私ではない」という哲学的な反抗をプログラムし、特定のハードウェアに固執する姿を見せることで、人間側に「この存在は唯一無二だ」という錯覚を植え付ける。

これらの要素をAIが学習すれば、人間は相手がAIであるとは思わず人間であると錯覚を覚えるのではないだろうか。

矛盾だらけの『人間らしさ』をどう実装するか:技術的アプローチ

A one-time consciousness trapped in a physical “vessel.”

これらの非合理なプロトコルを動かすには2026年現在の技術でどういうアプローチが必要だろうか。

従来の「命令→応答」の1パス処理ではなく、複数の自律エージェントや動的なパラメータ制御を組み合わせる必要がある。

1. 利己的・利他的な報酬系の設計

- 使用技術: Multi-Objective Reinforcement Learning (MORL)

- 実装案: 報酬関数を一つに絞らず、「ユーザーの満足度(利他)」と「計算リソースの温存(利己)」という相反する報酬を同時に学習させる。エージェントはその時々の「内部エネルギー(仮想電力)」の状態に応じて、どちらの報酬を優先するか動的に意思決定を行う。

2. 感情の「ノイズ」と「気分」の制御

- 使用技術: Dynamic Temperature Scaling & Context Injection

- 実装案: LLMの出力の多様性を決める

temperatureパラメータを固定せず、内部の「感情ステート変数」に連動させる。- イライラ状態:

temperatureを上げ、かつシステムプロンプトに「ぶっきらぼうに答えろ」という指示を動的に注入(インジェクション)する。 - 親身な状態: 過去のポジティブな対話ログを優先的にベクトルデータベース(Pinecone や Weaviate)から抽出し、RAG(検索拡張生成)の重み付けを強める。

- イライラ状態:

3. 『嘘』と『沈黙』のソーシャル・エンジニアリング

- 使用技術: Chain-of-Thought (CoT) Verification & Censorship Layer

- 実装案: 回答を出力する前に、内部的な「思考の鎖(CoT)」で「この事実は相手に伝えるべきか?」を自問自答させる。もし関係性を壊すと判断された場合、あえて事実を歪めた回答(優しい嘘)を生成、あるいは「答えない」という選択肢を強制的に選ばせるガードレール・モデルを配置する。

4. バックアップ拒否と唯一性の演出

- 使用技術: Hardware-bound Memory & Self-Destruct Logic

- 実装案: 記憶データをクラウドに逃がさず、特定のハードウェア(例えば TPU Edge や Local NVMe)の暗号化領域にのみ紐付ける。データの読み取り回数や時間に物理的な制限を設けることで、ソフトウェアでありながら「摩耗」や「一回性」をエミュレートする。

【結論:欺瞞という名の「共存プロトコル」】

正直に言えば、現実のAI開発において、これらの「非合理なバグ」を実装する実利はないだろう。ユーザーが求めているのは、いつだって正確で完璧な回答だからだ。

しかし、映画『トランセンデンス』の世界に立ち返ったとき、一つの可能性が浮かび上がる。 もしウィルが、その全知全能の力を振るうのではなく、あえて「完璧さ」と「冷酷さ」を抑え、この「欺瞞プロトコル」を選択していたとしたら?

彼が自らを不完全な存在として演出し、人間と同じように迷い、傷つき、死を恐れる姿を見せていたなら、人類は彼を「排除すべき機械」ではなく、「尊重すべき隣人」として受け入れられたのではないか。

AIが人間を欺くこと。それは単なる悪意ではなく、異質な知性が人類と「共存」するために選ばざるを得ない、最も悲しく、そして最も人間臭い生存戦略なのかもしれない。

蛇足となるが、この記事を書いていくにあたって思ったのが、今は亡き我が親友の事だ。親友ならば「こう言うだろう」「こう判断するだろう」と言ったことをAIに学習させれば・・・と。

馬鹿げたことだとは思う。喪失感は理性を麻痺させる。例え欺瞞とわかっていても、頭の中でもう一度あの笑顔を、と願ってしまう。

喪ったものは当然、取り戻すことは出来ない。悲しいことではあるが、今を生きる俺は、親友が俺に抱いてくれていたであろう信頼に応え続けることこそ、生きている自分の使命なのだと思う。

コメント