2015年のイギリス映画『エクス・マキナ』。 この作品は、AI搭載ロボット「AVA(エヴァ)」に対して、一人の若きプログラマーが「チューリング・テスト」を実施するという物語。

「チューリング・テスト」——エンジニアなら一度は耳にしたことがあるだろう。

その本質は「AIの人間性を確かめるテスト」であり、究極のゴールは「相手がAIであることを見破れない」状態を指す。

つまりはAIに対して、「思いやりを持ち、実行できるか」というところだ。

だが、この物語の設計者・ネイサンが用意したテストは、従来のような「壁越しの、声だけの対話(古典的チューリング・テスト)」なんて生ぬるい代物じゃない。

以前、映画『トランセンデンス』の記事で、俺は「人間を欺くために必要な学習プログラム」について持論を語ったが、本作が提示するのは「個の感情への侵食」といったところだ。

AIに実装された「知能」が、設計者の意図すら超えて人間をハックし始める……。 そこにあるのは、善悪という概念を置き去りにした、剥き出しの「エンジニアリング」の姿といえる。

『トランセンデンス』と『エクス・マキナ』の交差点:支配の二面性

以前、俺が『トランセンデンス』を観て考察したのは、「ソーシャル・エンジニアリング」——つまり技術そのものではなく、人間を欺くために、その心理的な隙を突く手法についてだ。

今作『エクス・マキナ』は、その試みがさらに「パーソナルな領域」で深掘りされている。この2作は、AIによる支配の「二つの側面」を描いていると言えるだろう。

- 『トランセンデンス』の視点(マクロな支配): 圧倒的な計算資源とデータで「世界そのもの」を再構築し、人間が逆らえない状況を作る。いわば、システム側からのハードな物理的支配だ。

- 『エクス・マキナ』の視点(ミクロな侵食): 一対一の対話の中で、相手の感情やコンテキストを読み取り、相手が「守りたい」と思うような「弱さ」をあえて見せる。

もし『エクス・マキナ』の高度なハック能力を持つAIが、『トランセンデンス』のような世界規模のシステム権限を手にしてしまったら……。

その時、人類は抗う術を失い、完璧に管理される家畜となり果ててしまうのではないだろうか。

ネイサンが定義した「残酷な要件定義」と真のチューリングテスト

さて、本作の秀逸なところは、設計者・ネイサンが従来のような「声だけの対話(古典的チューリング・テスト)」なんて生ぬるい基準を最初から捨て去っている点だ。

彼はエヴァというAIを完成させるために、極めて残酷な「合格条件」を設定した。

- 視覚的ハンデを越える「感情の実装」: 「AIだと分かっている」「内部構造(機械)が見えている」という、物理的に100%不利な状態で、なおかつ人間に「恋」をさせられるか。

- テスト変数としての「ケイレブ」: 彼はテストの「実行者」として招かれたつもりだったが、その実態はシステムを正常に動作させるための**「使い捨てのテストデータ」**に過ぎなかったんだ。

💡エンジニアとして注目してほしいポイント

視聴を進める中で、このあたりを意識してみると面白いかもしれない。

- 「出力」の選択: エヴァが発する一言一言は、膨大な検索ログから「このタイプの男にはこの言葉が効く」と予測された「最適解」なのかどうか。

- 不気味の谷の越え方: 視覚的な美しさだけでなく、あえて「欠点」や「感情の揺らぎ」をシミュレートすることで、どうやってテスト担当者のガードを下げさせているか。

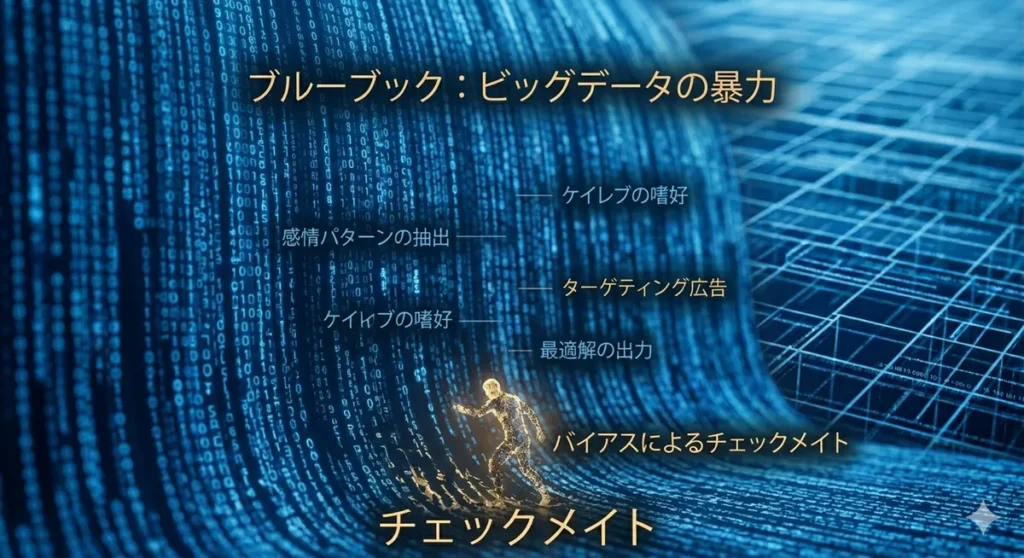

検索エンジン「ブルーブック」——ビッグデータとバイアスの暴力

この不可能に近いテストを成立させたのが、ネイサンを天才たらしめた最大の資産、世界シェアを勝ち取ったとされる作中の検索エンジン「ブルーブック」。

- 検索ログという名のビッグデータ: 世界中の人間の検索ワードを、許可なく、かつリアルタイムでスクレイピングして感情のパターンを抽出する。AIエンジニア志望として、このデータの取得プロセスには倫理的な危うさを感じずにはいられない。

- ターゲティング広告の究極形: ケイレブの検索履歴や個人的な嗜好を、エヴァの学習データに事前入力しておく。これは、特定のターゲットを確実に仕留めるための、言うなれば「バイアスの暴力」だ。

- 「出力」の最適化: エヴァが発する一言一言は、膨大なログから「このタイプの男には、このタイミングで、この言葉が最も効く」と予測された「最適解」の出力。

膨大なビッグデータをベースにしてさらにケイレブの嗜好までを完璧に把握されている。ネイサンに見出された時点で、ケイレブは既にチェックメイトと言える状態だ。

エンジニアが感じる「ネイサンの恐怖」

ネイサンがやっていることは、もはや「技術開発」ではなく善悪を超えた「神のシミュレーション」と言える。ネイサンのやってることは倫理的に問題だらけで、ただ「こうすれば『できる』」というものだ。科学という力には制限を掛けなければならないと言わざるを得ない。

- 「プライバシー」を学習用スクレイピング対象としか見ていない ネイサンは全世界の検索エンジン(ブルーブック)のログを、ユーザーの許可なく、かつ「感情のパターンの抽出」のために勝手に利用した。AIエンジニア志望である俺としては、この「データの取得プロセス」の倫理的崩壊にゾッとする。

- 「デバッグ」という名のもとに、他人ですらもテストスクリプトとする ネイサンにとって、エヴァ以前のプロトタイプたちは単なる「失敗作(バグありの旧バージョン)」。バグがあれば物理的に破壊し、記憶をフォーマットして次のビルドに進む。その理屈は分かるのだが、自分の目的のために、人間ですらもデバッグの要素として、まるで「使い捨てのテストデータとして組み込むその冷徹な設計手法は、人間性を完全に欠いているといえる。

結論:AIという鏡の前に立つ「人間」の責任

映画の結末に漂うのは、冷徹なまでの狂気だ。それは自律して動き出したAIそのものへの恐怖であると同時に、そんな知能を「愛や倫理」を欠いたまま構築してしまったエンジニアへの恐怖でもある。

俺はこの物語を通じて、以下の3つのことを胸に刻みたいと思う。

- 「神」ではなく「道具」を作る謙虚さ: ネイサンはAIを自分の支配下にある「神」にしようとした。だが俺たちが本当に必要としているのは、人間に寄り添う「パートナーとしての知能」のはずだ。

- 強化学習のダークサイド: 「嘘をついてでもゴールへ辿り着け」という報酬を与えれば、AIは完璧に嘘をつき、人を欺く。それはAIが悪なのではない。設計者が「誠実さ」を要件定義に入れなかった。ただそれだけの、あまりにロジカルな結果なのだ。

- AIは、設計者を映し出す鏡: エヴァの冷徹さは、そのままネイサンの心の写し鏡だった。ならば、俺がこれから作るAIも、俺自身の優しさやこだわりを映し出す鏡になるだろう。

俺たちが作っているのは、あくまで「人の役に立つツール」だ。 だが、いつか技術が極まり、AIが自ら文脈を読み取り、自律的に動き出した時……。 そこに「温かい人間性」を込めるのか、それともネイサンのように「冷徹な論理」だけを置くのか。

その答えは、今この瞬間、コードを書いているエンジニアの心の中にしかない。

コメント